通訊設(shè)備的發(fā)展與應(yīng)用

通訊設(shè)備是現(xiàn)代社會(huì)中不可或缺的技術(shù)工具,它們通過(guò)傳輸信息,連接人與人、人與機(jī)器,推動(dòng)了全球信息化的進(jìn)程。從早期的電報(bào)、電話,到如今的智能手機(jī)、5G網(wǎng)絡(luò)和物聯(lián)網(wǎng)設(shè)備,通訊設(shè)備經(jīng)歷了飛速的演變。

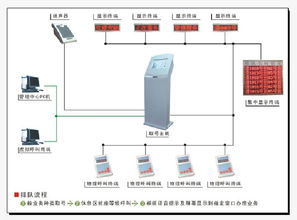

通訊設(shè)備主要包括有線設(shè)備和無(wú)線設(shè)備兩大類(lèi)。有線設(shè)備如固定電話、光纖調(diào)制解調(diào)器,依賴(lài)物理線路傳輸信號(hào),穩(wěn)定性高但靈活性有限;無(wú)線設(shè)備則包括手機(jī)、對(duì)講機(jī)、衛(wèi)星通訊系統(tǒng)等,通過(guò)電磁波實(shí)現(xiàn)信息傳遞,使用便捷,覆蓋范圍廣。近年來(lái),隨著5G技術(shù)的普及,無(wú)線通訊在速度、延遲和連接密度方面取得了突破,為智能城市、遠(yuǎn)程醫(yī)療和自動(dòng)駕駛等領(lǐng)域提供了支持。

通訊設(shè)備的應(yīng)用已滲透到各個(gè)行業(yè)。在日常生活中,人們依賴(lài)智能手機(jī)進(jìn)行即時(shí)通訊、社交媒體互動(dòng)和在線購(gòu)物;在企業(yè)中,視頻會(huì)議系統(tǒng)和云通訊平臺(tái)提升了協(xié)作效率;在應(yīng)急和軍事領(lǐng)域,可靠的通訊設(shè)備是保障安全的關(guān)鍵。物聯(lián)網(wǎng)設(shè)備的興起,使通訊不再局限于人際交流,而是擴(kuò)展到物與物之間的智能互聯(lián),如智能家居和工業(yè)自動(dòng)化。

通訊設(shè)備的快速發(fā)展也帶來(lái)了挑戰(zhàn),包括網(wǎng)絡(luò)安全問(wèn)題、隱私泄露風(fēng)險(xiǎn)以及電子垃圾對(duì)環(huán)境的影響。未來(lái),隨著6G技術(shù)、量子通訊等前沿領(lǐng)域的探索,通訊設(shè)備將進(jìn)一步向高速、安全、節(jié)能的方向演進(jìn)。

通訊設(shè)備作為信息時(shí)代的基石,不斷推動(dòng)社會(huì)進(jìn)步。用戶(hù)在選擇和使用時(shí),應(yīng)注重安全性、兼容性和可持續(xù)性,以實(shí)現(xiàn)更高效、安全的溝通體驗(yàn)。

如若轉(zhuǎn)載,請(qǐng)注明出處:http://m.ewlx.cn/product/12.html

更新時(shí)間:2026-05-05 07:15:57